Es ist immer wieder eine Herausforderung, im Rewe zu stehen und die an den Amazon echo diktierten Produkte auf der Einkaufsliste zu finden. Dabei ist „Creme brüllen“ noch eines der einfachsten. Und auch die Apple-Kollegin Siri hat an vielen Stellen massive Schwierigkeiten, selbst einfache Befehle zu verstehen. Der Autopilot von Tesla? Selbst auf der geradesten aller geraden Autobahnen übergibt er mit einem lauten „lülülü“ spontan und vorsorglich schonmal hart bremsend das Ruder zurück an den menschlichen Fahrer.

Es war ein großer Skandal in der öffentlichen Wahrnehmung, als bekannt wurde, dass Amazon ganz regulär und selbstverständlich aufgezeichnete Alexa-Befehle auswertet. Und das mit einer Armee von mutmaßlich offshore outgesourcten durch und durch menschlichen Dienstleistern. Dass es anders gar nicht geht, dass Trainingsdaten freilich manuell aufbereitet werden müssen, erschien völlig abwegig. Ist es aber nicht. Natürlich kann Alexa nur, was Menschen ihr beigebracht und programmiert haben.

Der institutionalisierte Erzfeind der Netzgemeinde, die GEMA, twitterte einst zu den Uploadfiltern des §13:

Die GEMA-PR-Abteilung hat sicher noch nicht die Kommentare unter den Facebook-Beiträgen des Postillion gelesen. Selbst erwachsenen Menschen schaffen es nicht, in einem grundsätzlich erstmal neutralen und kontextlosen Umfeld wie einer Facebook-Timeline eine Parodie als solche zu erkennen. Aber eine Künstliche Intelligenz soll das können? Ein Trugschluss.

Künstliche Intelligenz gibt es hauptsächlich in PowerPoint

Dabei ist die Bezeichnung „Künstliche Intelligenz“ an sich schon zweifelhaft. Was dahinter zu verstehen ist, kann von einfachen Programmen mit If-Bedingungen über neuronale Netze bis hin zur Semiotik reichen — je nachdem, in welcher schwurbeligen PowerPoint-Präsentation der Begriff gerade verwendet wird. Meistens ist damit das Maschinelle Lernen gemeint, was eigentlich eine Submenge von Künstlicher Intelligenz ist. Daneben stehen noch andere für Intelligenz notwendige Bereiche wie zum Beispiel Wissensrepräsentation, Sprachverständnis und Steuerung von Bewegungen.

Beim Maschinellen Lernen lernt ein System von aufbereiteten Trainingsdaten und wendet die erkannten Muster dann auf bisher nicht gesehenen Input an. Das ist besonders nice, wenn man viele Daten hat und darauf repetitive Aufgaben erfüllen muss oder in Videos und Bilder bekannte Objekte identifizieren will. Oder wenn man in einem Meer von Daten die sprichwörtliche Nadel im Heuhaufen sucht, etwa unter tausenden Kontobewegungen Geldwäsche finden möchte (was N26 dringend mal tun sollte).

Das Prinzip mit den Mustern hat auch Nachteile und Herausforderungen. Ist die Menge der Testdaten zu klein, dann passiert das „Overfitting“. Dabei werden kleine zufällige Eigenschaften überbewertet und das Ergebnis ist nutzlos. Fast so, wie wenn ein Mensch falsche Vorurteile hegt. Oder die Trainingsdaten unterliegen einem Bias. So geschehen bei dem Twitter-Bot „Tay“ von Microsoft, der durch das Training mit Internet-Trolls zu einem Nazi und Sexisten wurde. Denn mehr als bekannte Muster reinterpretieren kann man mit Maschinellem Lernen nicht.

Dieses Reinterpretieren muss man sich stets vor Augen halten, um Maschinelles Lernen nicht zu überschätzen. Sowohl als Entwickler der Software, als Benutzer als auch als Twittermensch der GEMA. Eine Gefahr liegt nicht in den Algorithmen, sondern bei den Leuten, die den Ergebnissen zu viel Bedeutung beimessen.

Eliza

Das Überschätzen Künstlicher Intelligenz hat Tradition. Bereits 1966 schrieb der Informatiker Joseph Weizenbaum ein Chatprogramm namens Eliza. Obwohl dessen Funktionalität meilenweit hinter der von Siri und Co. war, unterstellten die Probanden dem Programm, das sich als Therapeut ausgab, ein tiefes Verständnis für ihre Probleme und Belange aufgebracht zu haben. Es gab ernsthaft praktizierende Psychotherapeuten, die das System für die Therapie einsetzen wollten. Für Weizenbaum ein Schock. Er wurde fortan zu einem Kritiker von Informationstechnologie und ihrem Einfluss auf die Gesellschaft, maßgeblich begründet in seinem 1977 erschienenen Buch „Die Macht der Computer und die Ohnmacht der Vernunft“. Dazu hat der Spiegel bereits 1978 geschrieben:

Die Macht der Computer wird aber erst unheimlich, wenn die Vernunft ihrer nicht mehr mächtig ist. Zum Beispiel dann, wenn mächtige Personen unserer Erde, mit den Möglichkeiten und Grenzen von Computern nicht vertraut, letzteren größere Leistungsfähigkeiten unterstellen, als man ihnen abverlangen kann. (Gefährlicher Dialog, Der Spiegel, 1978)

Schaut man sich die pauschalen oberflächlichen Äußerungen der Politik an, sei es im aktuellen Koalitionsvertrag oder im Parteiprogramm, dann ist diese Unheimlichkeit bereits Realität geworden.

Fortschritt braucht einen milliardenschweren Namen

Und dennoch, die „Künstliche Intelligenz“ ist wohl das allgemein anerkannte pars pro toto des technologischen Fortschritts. So auch ein wenig überbetont in der aktuellen Kolumne von Sascha Lobo. Zurecht bemängelt er dort, dass von den Milliarden, die die Politik in die Entwicklung von KI investieren wollte, irgendwie verunfallt nun doch nichts budgetiert wurde. Das aber ganz allgemein als Problem zu sehen, ist zu undifferenziert. Zwischen einer KI, die einen Schachweltmeister besiegt und der Rettung der deutschen Industrie liegt viel. Letzten Endes ist das autonom fahrende Auto, die reibungslos laufende Mittelstandsfabrik aus Robotern und die behördlich komplett maschinell überprüfte Steuererklärung maximal eine Kombination ganz verschiedener Technologien, darunter viele nicht mal in der Informatik verankert. Da wird die Förderung „Künstliche Intelligenz“ maximal zu einem hipperen Begriff für „einfach mal alles, was technologischer Fortschritt ist und nix mit Infrastruktur zu tun hat“.

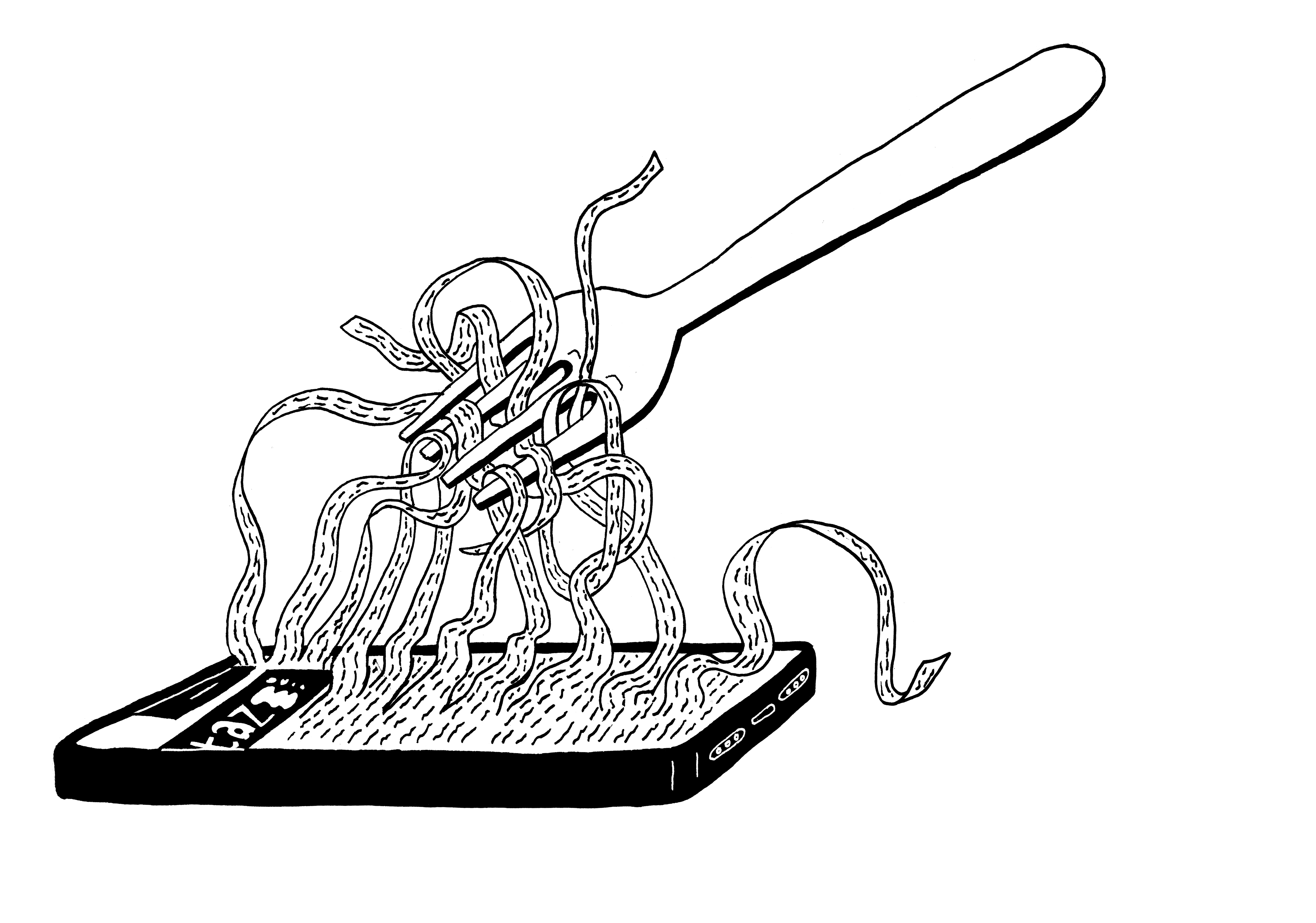

Vom Shitty Robot zur Büroklammer-Weltherrschaft

Und während sich auf der einen Seite eine Kultur bildet, die schlechte Roboter feiert (/r/shittyrobots) und sich über das Buzzword der KI lustig macht, gibt es Denker, die aus der Vogelperspektive dem ganzen Thema eine harte dystopische Note geben. Dazu gehört der Philosoph Nick Bostrom von der Oxford University. Er sieht in seinen Publikationen, allen voran in seinem Bestseller-Buch „Superintelligence. Paths, Dangers, Strategies“ große Vorbehalte für künstliche Intelligenz. Nicht in der KI von heute, sondern in der in hundert Jahren. Er stellt Überlegungen auf, was die Simulation eines kompletten Gehirns („Whole Brain Emulation“) oder die Existenz einer Superintelligenz für die Menschheit bedeuten wird. Was, wenn es eine superintelligente Maschine gibt, deren Aufgabe es ist, Büroklammern herzustellen? Was, wenn sie ihre Aufgabe so ernst nimmt, dass sie dabei zerstörerisch und ohne Moral alle verfügbaren Ressourcen einsetzt?

Irgendwo zwischen den Shitty Robots auf YouTube, der hibbeligen deutschen Industrie der alten Zeit und der Dystopie einer Büroklammer-Superintelligenz muss eines liegen: Das ethische Handeln. Oder die Safety, wie Bostrom es nennt. Verantwortlich dafür ist jeder, ganz besonders nicht nur der Entwickler. Technikfolgenabschätzung muss Teil der vernünftigen menschlichen Kultur sein. In den Worten von Joseph Weizenbaum, bereits 1977 formuliert:

„Ich plädiere für den rationalen Einsatz von Naturwissenschaft und Technik, nicht für deren Mystifikation und erst recht nicht für deren Preisgabe. Ich fordere die Einführung eines ethischen Denkens in die naturwissenschaftliche Planung. Ich bekämpfe den Imperialismus der instrumentellen Vernunft, nicht die Vernunft an sich.“